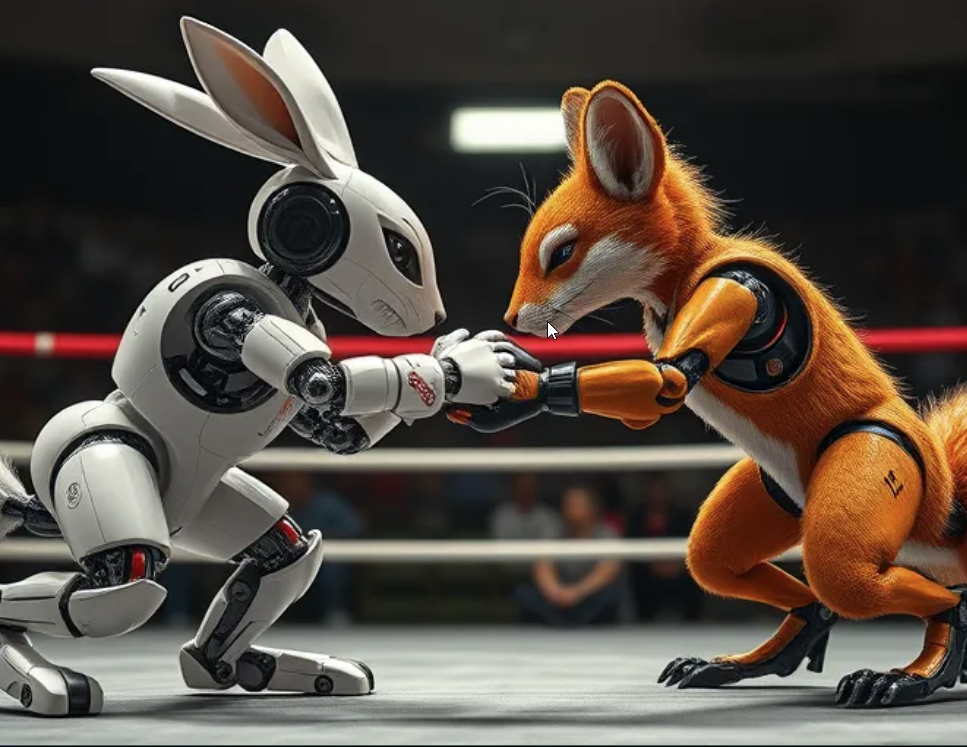

Est-ce qu'o1 rend GPT 4o obsolète ?

🔮Alors, quelle est donc cette magie noire cachée derrière le nouveau modèle o1 d'OpenAI ? Et surtout, dois-je au plus vite l'intégrer dans mes applications pour remplacer ce "vieux" GPT-4o ? 🧙♂️

Avant de nous précipiter pour déclarer GPT-4o obsolète, prenons un moment pour explorer ce qui distingue réellement o1. Cette innovation marque-t-elle un tournant décisif dans le développement de l'intelligence artificielle ?

GPT, Claude ou Grok, ce ne sont que des "systèmes 1"

Dans son ouvrage Thinking, Fast and Slow, Daniel Kahneman explore les mécanismes de la pensée humaine et propose une distinction entre deux systèmes cognitifs qui régissent la manière dont nous prenons des décisions et traitons l'information.

- ⚡ Le système 1 est rapide, intuitif, et automatique. Il fonctionne de manière inconsciente, mobilisant des associations mentales basées sur des expériences passées, des habitudes ou des réflexes. Ce mode de pensée est particulièrement efficace pour des tâches simples ou répétitives, où une réponse immédiate est nécessaire, comme reconnaître un visage ou réagir à un danger imminent. Cependant, bien que ce système soit rapide, il est aussi sujet à des biais cognitifs, car il se base sur des heuristiques (des raccourcis mentaux) plutôt que sur une réflexion approfondie.

- 🧠Le système 2, quant à lui, est plus lent, délibéré et analytique. Il intervient lorsque nous sommes confrontés à des situations nouvelles, complexes ou ambigües, et nécessite un effort mental conscient. Ce système est mobilisé lorsque nous devons résoudre un problème de mathématiques, évaluer une situation complexe, ou prendre une décision en tenant compte de plusieurs variables. Contrairement au système 1, le système 2 est capable de rationaliser et de peser les différentes options avant de parvenir à une conclusion. Il est donc plus fiable, mais aussi plus coûteux en termes d'énergie et de temps.

Kahneman montre que dans la plupart des situations de la vie quotidienne, nous utilisons principalement le système 1, car il est rapide et peu gourmand en ressources cognitives. Cependant, dans des circonstances plus complexes ou inédites, le recours au système 2 devient essentiel pour éviter des erreurs ou des jugements hâtifs. Cette dualité entre ces deux systèmes de pensée est fondamentale pour comprendre comment nous naviguons dans notre environnement et comment les biais peuvent influencer nos prises de décisions.

Vous l'aurez compris, la plupart des modèles IA, que ce soit GPT-4o, Claude 3.5 ou autres, sont des "systèmes 1". Ils répondaient rapidement et efficacement, mais avec des biais, à des questions ou des tâches relativement simples, mais sans réelle capacité de réflexion. Leurs réponses sont le fruit d'un apprentissage et non d'un raisonnement structuré.

La chaîne de pensée ou l'émergence d'un "système 2"

Le point de bascule s'est produit en 2022 avec la publication de l'article de recherche Chain of Thought (la chaîne de pensée), rédigé par une équipe de chercheurs de Google, parmi lesquels Jason Wei, Xuezhi Wang et Dale Schuurmans.

Cet article propose une approche innovante qui permet à un grand modèle de langage (LLM) de développer un raisonnement plus élaboré en décomposant ses réponses en plusieurs étapes intermédiaires, comme le ferait un humain face à un problème complexe. En introduisant cette méthode, les chercheurs ont montré qu'un LLM pouvait être "forcé" à réfléchir en employant des prompts spécifiques. Ce processus, nommé Chain of Thought prompting, mime les rouages du "système 2" de Daniel Kahneman, un système de pensée plus lent et analytique, que le modèle active pour aborder des tâches complexes telles que les problèmes mathématiques ou la logique.

Cette approche, bien qu'efficace, dépendait alors de la formulation des prompts par les utilisateurs. Chaque fois que l'on souhaitait que le modèle raisonne, il fallait structurer précisément la requête pour guider le modèle à travers les étapes nécessaires à la résolution du problème. En d'autres termes, la capacité de l'IA à raisonner reposait toujours sur la manière dont l'humain pilotait la réflexion, ce qui limitait son automatisation et son efficacité dans des situations moins guidées.

Allez, petite devinette, qu'a fait Jason Wei depuis l'écriture de cet article ? Et bien il a rejoint OpenAI pour travailler sur le projet Strawberry, qui a abouti au nouveau modèle ChatGPT o1. Entre le modèle Transformer et les Chain Of Thoughts, heureusement que Google est là pour fournir à OpenAI des travaux de recherche pour innover.

o1 : Un nouveau modèle "système 2" autonome

Cependant, pour son nouveau modèle o1, OpenAI ne s'est pas contenté de reprendre simplement l'approche de Google basée sur la Chain of Thought. Pour que cette capacité de raisonnement soit vraiment efficace, il a fallu l'intégrer directement au cœur du modèle, et cela a été rendu possible grâce à un double entraînement :

-

Apprentissage du langage : Comme GPT-4o et les autres modèles, o1 a d'abord suivi un entraînement supervisé classique. Cette phase consiste à exposer le modèle à d'immenses quantités de données textuelles pour qu'il apprenne à générer des phrases cohérentes et pertinentes. À ce stade, o1 se comportait comme un modèle de "système 1", capable de donner des réponses rapides, mais sans réelle réflexion.

-

Apprentissage du raisonnement : La nouveauté se situe ici. Après l'entraînement initial, o1 a été soumis à une deuxième phase appelée apprentissage par renforcement. Dans ce processus, le modèle a été forcé à répondre aux questions en suivant un raisonnement détaillé. Ensuite, sa réponse était évaluée : si le raisonnement et la réponse étaient corrects, le modèle recevait une "récompense", sinon il était "puni". Ce processus permet de modifier le comportement du modèle, en augmentant la probabilité qu'il génère des raisonnements corrects et en réduisant les erreurs. Ce type d'apprentissage aide o1 à structurer sa réflexion avant de répondre.

Grâce à cet apprentissage par renforcement, o1 devient ainsi capable de "penser" de manière autonome, et est particulièrement efficace pour résoudre des problèmes complexes en mathématiques, sciences ou programmation, avec une précision bien supérieure aux anciens modèles qui reposaient uniquement sur des associations rapides de données.

Une réflexion qui n'est pas sans faille.

Le raisonnement d'o1 n'est pas sans inconvénients. Ses nouvelles capacités de réflexion ont un coût. Contrairement à GPT-4o, qui répond instantanément à des questions simples, o1 prend plus de temps pour "réfléchir" avant de donner une réponse.

Par exemple, si vous lui demandez la date de la mort de Napoléon, o1 pourrait prendre quelques secondes pour analyser la question, là où GPT-4o fournirait la réponse immédiatement. Cette lenteur s'explique par le fait qu'o1 tente de construire un raisonnement, même quand ce n'est pas nécessaire pour des questions aussi simples. Pire encore, si vous lui demandez de ne pas réfléchir, il pourrait quand même tenter de réfléchir à comment ne pas réfléchir !

En outre, o1 est tout autant sujet aux hallucinations. Pire, o1 peut non seulement halluciner un résultat, mais aussi la méthode pour y parvenir :

En somme, o1 n'est pas adapté aux tâches simples et rapides, comme la rédaction de résumés ou les questions de culture générale. Bien que sa capacité de raisonnement soit plus sophistiquée, cela le rend moins rapide et efficace pour des tâches basiques, où GPT-4o excelle. De plus, le fait qu'o1 prenne plus de temps pour formuler une réponse et semble "réfléchir" ne garantit pas pour autant la fiabilité de ses réponses. La règle d'or reste inchangée : ne faites jamais confiance à une IA pour des informations que vous ne pouvez pas vérifier vous-même.

o1, une révolution, mais pas la fin de GPT-4o

En résumé, o1 est bien plus qu'une simple mise à jour. Il représente une évolution vers une IA capable de véritablement "penser" avant d'agir, ce qui en fait un outil puissant pour les développeurs et utilisateurs cherchant à résoudre des problèmes complexes. Cependant, son utilisation doit être bien calibrée en fonction des besoins.

Alors, est-ce que o1 va rendre GPT-4o obsolète dans vos développements ? Pas encore. La réponse, comme toujours, dépend de ce que vous cherchez à accomplir. Pour des tâches simples et rapides, GPT-4o conserve une nette longueur d'avance. Mais pour tout ce qui requiert du raisonnement, o1 s'impose comme une nouvelle norme à ne pas ignorer.

La révolution est en marche, mais elle ne remplace pas tout sur son passage… du moins, pas encore.